La UE fixa el rumb cap a una IA a dues velocitats

La primera llei global classifica els sistemes d’IA segons el risc i prohibeix pràctiques abusives

L’excés regulatori podria frenar la innovació i deixar Europa fora de la cursa de la IA

L’1 d’agost del 2024 marca una fita històrica en la regulació de la intel·ligència artificial (IA) a escala mundial. La Unió Europea ha posat en marxa el seu reglament d’intel·ligència artificial, conegut com a AI Act, la primera llei del món que regula de manera integral aquesta tecnologia emergent. Aquesta normativa pionera estableix un marc legal per a l’ús i el desenvolupament de sistemes d’IA, amb l’objectiu de garantir la seguretat i el respecte pels drets fonamentals dels ciutadans europeus.

La presidència espanyola de la UE va tenir un paper en la negociació d’aquesta llei, ja que va aconseguir un acord abans de finalitzar el desembre del 2023. No obstant això, el camí no va estar exempt de tensions, amb França mostrant-se partidària d’una regulació menys estricta per no frustrar l’èxit d’empreses emergents com ara Mistral AI, start-up francesa que ha segellat una aliança amb Microsoft i que amb el nou reglament hauria tingut dificultats per triomfar.

El reglament adopta un enfocament basat en el risc i classifica els sistemes d’IA en quatre categories: risc mínim, limitat, alt i inacceptable. Les dues últimes categories seran les més estretament vigilades. Entre les pràctiques prohibides, destaquen els sistemes de categorització biomètrica basats en creences polítiques, religioses, raça o orientació sexual.

La major part de la legislació s’aplicarà a partir del 2026, però algunes disposicions ja seran vinculants el 2025. En l’actual escenari de la IA, cada setmana hi ha novetats i llançaments de noves aplicacions i avenços. Un any sembla una eternitat.

Aquesta regulació ha generat un intens debat sobre el seu impacte en la competitivitat europea en el camp de la IA. Mentre que alguns experts argumenten que la UE està prenent el lideratge en la promoció d’una IA ètica i responsable, d’altres temen que l’excés regulatori freni la innovació i deixi Europa fora de la cursa global en el desenvolupament de la tecnologia.

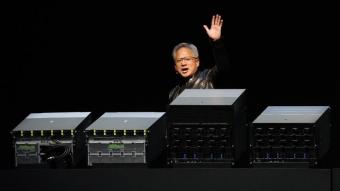

El contrast europeu amb l’enfocament menys restrictiu dels Estats Units i el control estatal de la Xina és evident. Aquests països han optat per una regulació més laxa, prioritzant el ràpid desenvolupament i implementació de sistemes d’IA, amb una competència ferotge entre tots dos. Això ha portat a qüestionar si la UE està sacrificant la seva competitivitat empresarial en nom de la protecció dels drets dels ciutadans, i perjudica així emprenedors, desenvolupadors i start-ups europeus.

Les implicacions per a les empreses europees són significatives. El nou marc legal requereix que les companyies adaptin els seus processos i productes per complir amb els estrictes requisits de seguretat, transparència i ètica. Això pot suposar costos addicionals i temps d’adaptació que podrien posar en desavantatge les empreses europees respecte als seus competidors globals.

Ja s’han vist exemples de com aquesta regulació està afectant el desplegament de tecnologies d’IA a Europa. Gegants com Apple i Meta han advertit que no desplegaran íntegrament la seva IA al continent per la confusió legal i les restriccions europees. Recentment, Meta va anunciar que no llançaria els seus nous models d’IA multimodal de codi obert (Llama 3.1) als 25 estats membres de la UE a causa de “la naturalesa impredictible de l’entorn normatiu europeu”. Paradoxalment, la Xina se n’haurà beneficiat en un temps rècord.

Aquest escenari planteja el risc d’una IA a dues velocitats: una versió més avançada i capaç per a la resta del món, i una altra de més limitada per a Europa, on bona part de les novetats de Silicon Valley estan capades per geolocalització. Exemples com el retard en el llançament de Copilot per a Windows 11 i l’arribada tardana de Google Bard (ara Gemini) a la UE il·lustren aquest problema.

Les autoritats europees mantenen una posició ferma en la regulació de les grans tecnològiques. La Comissió Europea ha imposat sancions milionàries a empreses com ara Apple, Meta i Microsoft per pràctiques anticompetitives i violacions de la privacitat. La multa rècord de 1.200 milions d’euros imposada a Meta el maig del 2023 per incompliment del reglament general de protecció de dades és un clar exemple d’aquesta línia d’actuació. I no serà pas l’únic.

La combinació de l’AI Act amb altres normatives com la llei de mercats digitals (DMA) està generant preocupació en el sector tecnològic. Hi ha qui argumenta que aquest marc regulatori podria ser una oportunitat per a Europa de preservar els seus ciutadans dels excessos dels gegants tecnològics i combatre els monopolis. Altres veus adverteixen que pretendre fortificar aquesta “illa regulatòria global” podria ser “un tret al peu” que freni la innovació i el desenvolupament al continent.

Els defensors de la regulació argumenten que establir estàndards ètics i de seguretat elevats situarà Europa com a líder global en IA responsable. Sostenen que, a llarg termini, això generarà més confiança en la tecnologia i fomentarà un desenvolupament sostenible i centrat en els humans. No volen que es repeteixin alguns dels errors comesos amb les xarxes socials.

Per contra, els crítics temen que la rigidesa normativa ofegui la creativitat i l’emprenedoria en el sector de la IA. Adverteixen que les start-ups europees es podrien trobar en desavantatge respecte a les seves contraparts americanes o asiàtiques, que operen en entorns menys restrictius.

El repte per a la UE, on posicions com la francesa semblen prudentment discordants, serà trobar l’equilibri adequat entre protecció i innovació. Caldrà veure com s’implementa la normativa a la pràctica i quins ajustos seran necessaris per adaptar-se a l’evolució ràpida de la IA. La flexibilitat i l’actualització del marc regulatori seran clau per no quedar enrere en la cursa global de la IA.

Mentre Europa aposta per una IA ètica i centrada en l’ésser humà, afronta el repte de mantenir la competitivitat en un entorn global frenètic i ferotge. El temps dirà si aquesta regulació inèdita situa la UE com a líder moral del desenvolupament de la IA o si, per contra, la relega a un paper secundari en la revolució del segle XXI.

Anyword: Escriure amb IA per a màrqueting

Anyword és una plataforma per generar textos de màrqueting efectius. Ideal per a descripcions de productes, contingut web i xarxes socials, destaca per l’optimització basada en dades. Integrada amb eines d’A/B testing, permet comparar variacions de contingut per trobar la més efectiva per al teu públic.

MakeMyTale: Històries amb IA que guanyen vida

MakeMyTale transforma textos en seqüències d’imatges, mantenint una continuïtat estilística única. Ideal per a escriptors, educadors i creatius, permet il·lustrar contes sense gran inversió. Tot i estar enfocada a una estètica de videojocs i tenir alguna limitació, és perfecte per crear històries visuals per a nens.

Speak AI: Anàlisi i transcripció d’àudio precís

Speak AI converteix àudio en text, facilitant la transcripció i l’anàlisi de dades d’àudio. Amb alta precisió, processa grans volums d’informació, detecta diverses veus i exporta anàlisis en format CSV. És útil per a periodistes, acadèmics i creadors de contingut, i s’integra amb Google Sheets, Zoom i YouTube.

Jasper: Assistent d’escriptura d’IA per a publicitat

Jasper, abans conegut com Jarvis, és un assistent d’escriptura versàtil amb una interfície fàcil d’usar i capacitats àmplies. Ideal per a la creació de publicacions de blocs, continguts de xarxes socials i còpies de vendes, se centra en campanyes de màrqueting oferint eines per crear còpies d’alta conversió.

Diccionari

Aprenentatge per reforç

L’aprenentatge per reforç és una tècnica d’aprenentatge automàtic en què un agent aprèn a prendre decisions mitjançant l’experiència, obtenint recompenses o penalitzacions segons les seves accions. L’objectiu és maximitzar la recompensa acumulada a llarg termini. S’utilitza en robòtica, sistemes de control autònom i jocs.

Aprenentatge semisupervisat

L’aprenentatge semisupervisat combina dades etiquetades i no etiquetades per entrenar models d’aprenentatge automàtic. Aquesta tècnica és útil quan només es disposa d’un petit conjunt de dades etiquetades però hi ha molta informació sense etiquetar. Permet millorar la precisió del model aprofitant més dades per aprendre patrons subjacents.

Aprenentatge no supervisat

L’aprenentatge no supervisat és una tècnica d’aprenentatge automàtic en què el model aprèn a partir de dades sense etiquetes predefinides. En lloc de fer prediccions, identifica patrons i estructures ocultes en les dades. Algorismes com el clustering (agrupació) i la reducció de dimensionalitat són casos d’aprenentatge no supervisat, útils en exploració i anàlisi de dades.

AutoML

AutoML (automated machine learning) és el procés d’automatització de la selecció, l’entrenament i l’afinament de models d’aprenentatge automàtic. Facilita l’accés a l’aprenentatge automàtic a persones amb poca experiència tècnica, optimitzant automàticament els models per obtenir el millor rendiment possible en menys temps.